En el panorama académico actual impulsado por la IA, las universidades se encuentran en una encrucijada. La rápida adopción de herramientas de IA generativa por parte de estudiantes, profesores e incluso la administración ha superado la política, poniendo en riesgo la integridad institucional, la privacidad de los datos y la calidad educativa. A medida que la innovación sigue aumentando, las universidades se ven sometidas a una presión cada vez mayor para seguir este ritmo con directrices claras y aplicables que garanticen el uso responsable de la IA entre sus partes interesadas.

Pero la realidad es cruda: según una encuesta reciente de EDUCAUSE, solo el 23% de los encuestados indicó que sus instituciones educativas cuentan con políticas aceptables relacionadas con la IA. Eso significa que la mayoría de los campus están navegando por la era post-GPT con una estructura limitada y mucho en juego. ¿El resultado? Confusión, agotamiento y aplicación inconsistente que erosiona la confianza en toda la comunidad académica.

La lucha oculta de la aplicación de políticas de IA en el mundo académico

Si bien la IA generativa continúa evolucionando, muchas universidades todavía están en modo reactivo. A pesar de este ritmo acelerado, algunas universidades han declarado una prohibición total del uso de la IA entre sus estudiantes y profesores. Es posible que este no sea un enfoque ideal, ya que no hace que los estudiantes estén preparados para el mundo real, donde la alfabetización en IA juega un papel muy importante. En las universidades, donde se permite el uso de la IA, se espera que los profesores mantengan los estándares académicos en un entorno en el que los ensayos, informes y tareas generados por la IA son cada vez más indistinguibles del trabajo escrito por los estudiantes. Sin políticas institucionales sólidas y herramientas que las respalden, los instructores se ven obligados a convertirse en investigadores, confiando en detectores de IA inconsistentes y en el juicio personal para tomar decisiones de alto riesgo.

Estos desafíos van más allá de la ineficiencia operativa:

- Incertidumbre e inconsistencia

El uso de múltiples herramientas de detección de IA, a menudo con resultados contradictorios, conduce a conjeturas, juicios erróneos y desconfianza en los estudiantes.

- Carga emocional y cognitiva

Los profesores informan de un aumento de los niveles de estrés y agotamiento, impulsados por la necesidad de aplicar políticas poco claras con poco apoyo institucional.

- Riesgos legales y de reputación

Las ambigüedades en torno al uso de la IA en las tesis de los estudiantes y en los resultados de las investigaciones exponen a las universidades a posibles problemas de propiedad intelectual y fallos de cumplimiento.

- Parálisis de la innovación

En ausencia de directrices claras, las instituciones corren el riesgo de restringir en exceso la IA (sofocando así el aprendizaje) o permitir un uso indebido sin control.

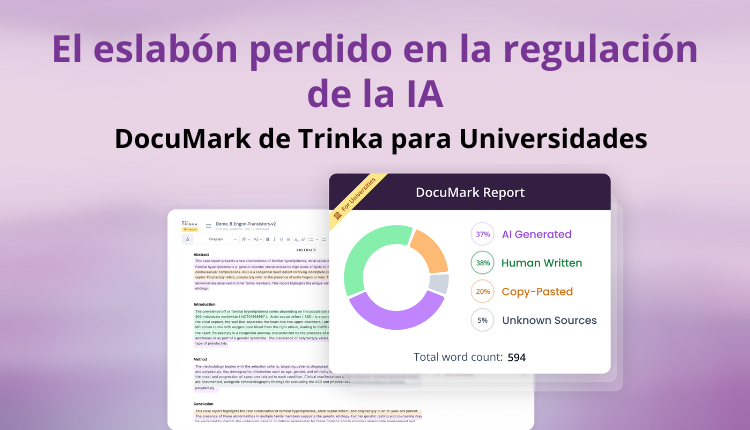

En resumen, la IA ha cambiado las reglas del juego, pero muchas instituciones siguen jugando con reglas antiguas. Aquí es donde interviene Trinka DocuMark, no como otra herramienta de detección de IA, sino como una plataforma integral creada para ayudar a las universidades a diseñar, implementar y mantener una gobernanza de IA efectiva con claridad y confianza.

DocuMark de Trinka: Verificación de autoría reinventada

En lugar de tratar la IA como una amenaza que hay que detectar, DocuMark de Trinka es una herramienta proactiva que reinventa la integridad académica centrándose en la transparencia, la autoría y la documentación del proceso de redacción. Permite a las universidades crear y aplicar políticas de IA escalables sin sobrecargar al profesorado ni comprometer el desarrollo de los estudiantes.

Así es como Trinka DocuMark ayuda a las universidades a abordar la alfabetización en IA para crear un impacto positivo en esta era post-GPT:

Validación automatizada de la autoría

DocuMark captura cómo evoluciona un documento en tiempo real documentando cada pulsación de tecla, revisión y generación de contenido basado en IA. Esta visión integral proporciona a las universidades y al cuerpo docente una prueba inequívoca de la autoría, lo que restablece la transparencia en el flujo de trabajo actual.

¿Cómo beneficia esto a las universidades? Las políticas que requieren el trabajo original de los estudiantes ahora se pueden hacer cumplir con evidencia objetiva por parte de los administradores y bibliotecarios. Las disputas sobre la autoría se vuelven más fáciles de resolver, lo que reduce la fricción en las investigaciones de mala conducta académica y los procesos de apelación.

Clasificación inteligente de contenido

A diferencia de los detectores genéricos que comparten porcentajes y códigos de colores, DocuMark ayuda a contextualizar la IA y no solo a marcarla. Las instituciones ahora pueden crear políticas matizadas que diferencien entre el uso permitido y el prohibido de la IA (por ejemplo, la IA para la corrección gramatical frente a la generación de contenidos). Esta función permite a las universidades ayudar a los profesores a ofrecer comentarios específicos, y los estudiantes aprenden a usar la IA de manera ética en lugar de secreta. Además, esta comprensión matizada también ayuda a identificar a los estudiantes en riesgo que pueden estar haciendo un mal uso de la IA por desesperación más que por intención de hacer trampa.

Análisis de esfuerzo y compromiso

DocuMark de Trinka proporciona líneas de tiempo visuales del esfuerzo de escritura de los estudiantes, lo que ayuda a los educadores a identificar no solo lo que se escribió, sino cómo se escribió: las horas empleadas, las iteraciones realizadas, la dependencia de la IA y más.

Estos conocimientos basados en el esfuerzo permiten a las instituciones apoyar a los estudiantes con dificultades o de alto riesgo desde el principio, perfeccionar las políticas de uso de la IA en función de patrones de participación reales y recompensar el esfuerzo honesto incluso cuando los resultados varían.

Informes seguros y compartibles

Cada análisis de documentos genera un informe completo con marca de tiempo y respuesta de progresión al estilo de video. Estos informes se pueden utilizar para auditorías, apelaciones académicas o como material de capacitación para profesores y estudiantes por igual.

Para las universidades, estos registros transparentes simplifican los flujos de trabajo administrativos, reducen la ambigüedad legal y proporcionan una base defendible para las decisiones tomadas en el marco de las políticas de IA.

Flexibilidad y personalización

Ya sea que una universidad aplique políticas de tolerancia cero o fomente el uso guiado de la IA, DocuMark se puede personalizar para alinearse con los estándares institucionales, los sistemas de gestión de aprendizaje existentes, los planes de estudio y las necesidades tecnológicas en evolución. Esto permite un uso fluido y sin complicaciones de esta herramienta transformadora tanto por parte de profesores como de estudiantes.

Una de las mejores características de DocuMark es que evoluciona a medida que evoluciona su política de IA, lo que respalda una gobernanza adaptable a largo plazo en lugar de una aplicación única para todos.

De la vigilancia reactiva a la política proactiva

Lo que las instituciones necesitan no es solo una mejor detección, sino una mejor dirección. Una política integral de IA, respaldada por una herramienta como Trinka DocuMark, puede restaurar la claridad de la integridad académica, reducir las cargas operativas y reavivar la relación entre estudiantes y profesores basada en la confianza y la transparencia.

Con DocuMark, las universidades pueden:

- Pasar de la sospecha al apoyo

- Recuperar el tiempo y la moral de los profesores

- Reforzar la propiedad y el aprendizaje de los estudiantes

- Lidere la adopción de IA ética y preparada para el futuro

El mundo post-GPT no tiene por qué ser caótico. Puede ser más inteligente, más justo y más empoderador para todos. Reserve una demostración gratuita con el equipo de Trinka DocuMark y vea cómo su institución puede liderar el camino de la innovación académica responsable sin perder de vista sus valores fundamentales.